شرکت تحلیلی CCS Insight پیشبینی میکند که هیاهوی پیرامون هوش مصنوعی مولد که با وعدههای وسوسهانگیز و مشکلات بالقوه همراه بوده است، در سال 2024 با یک واقعیت نگرانکننده مواجه خواهد شد.

تحلیلگران این شرکت پیشبینی میکنند که کمرنگ شدن هایپ، افزایش هزینهها و افزایش درخواستها برای وضع مقررات، نشانهای از کندی در این بخش خواهد بود.

بن وود، تحلیلگر ارشد CCS Insight، فکر میکند که این بخش به پذیرش واقعیت نیاز دارد و میگوید:

در حال حاضر همه از هوش مصنوعی مولد صحبت میکنند. اما هیاهوی هوش مصنوعی مولد در سال 2023 به قدری زیاد بود که فکر میکنیم بیش از حد هایپ شده است و موانع زیادی وجود دارد که باید از آن عبور کرد تا به بازار عرضه شود.

پیچیدگی و هزینههای بالای استقرار و حفظ مدلهای هوش مصنوعی مولد، مانند ChatGPT و Google Bard، بهعنوان عوامل بازدارنده قابل توجهی معرفی میشوند.

موانع ذکر شده برای ورود به این حوزه، ممکن است بسیاری از سازمانها و توسعهدهندگان را از استفاده از این فناوری منصرف کند.

از سوی دیگر، این واقعیتها فراتر از پیامدهای مالی است. انتظار میرود سرعت سریع پیشرفت در هوش مصنوعی، وضع مقررات را، به ویژه، در اتحادیه اروپا به چالش بکشد.

وظیفه قانونگذاری عظیم هوش مصنوعی

اتحادیه اروپا در حال آماده شدن برای معرفی مقررات خاصی برای هوش مصنوعی است. با این حال، CCS Insight پیشبینی میکند که احتمالاً چندین بار در این مورد تجدید نظر خواهند کرد. وود عقیده دارد که قانونگذاری تا اواخر سال 2024 نهایی نخواهد شد و صنعت را مجبور میکند تا گامهای اولیه خود تنظیمی را بردارد.

قانون پیشنهادی هوش مصنوعی، یک بخش مهم از مقررات، بحثهایی را در جامعه هوش مصنوعی برانگیخته است. به همین دلیل، شرکتهای بزرگ هوش مصنوعی در حال حاضر از رویکردهای متفاوتی برای مقررات حمایت میکنند.

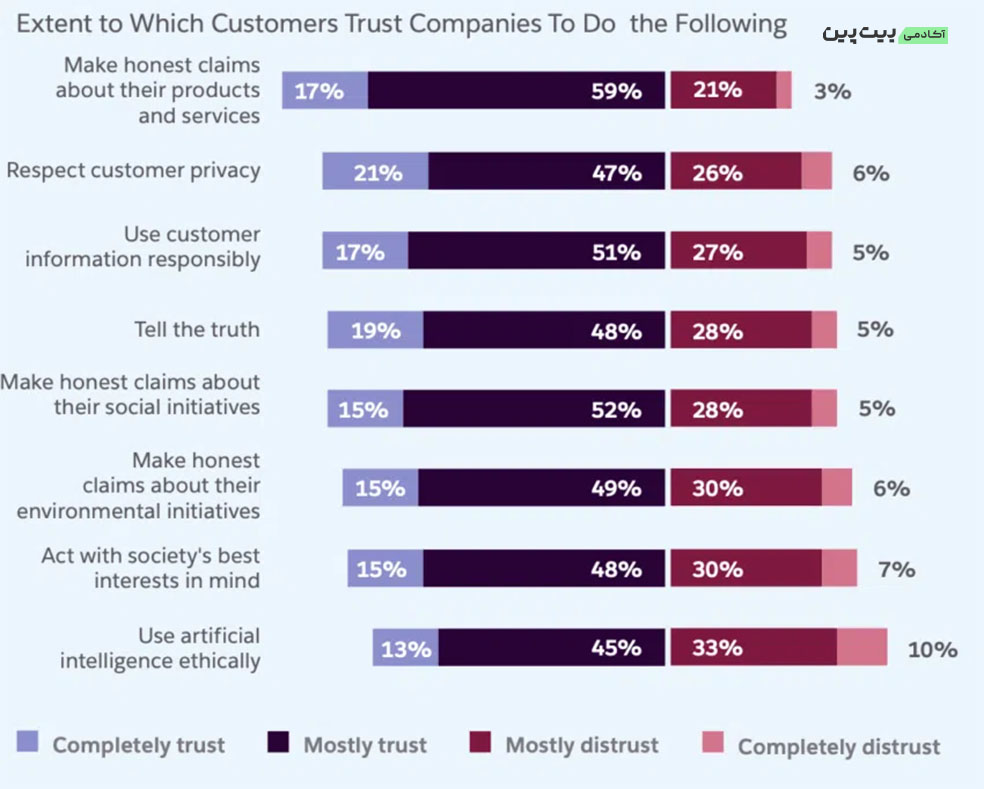

این موضوع بحثهای مهمی را در مورد استفاده اخلاقی از هوش مصنوعی به راه انداخته است. بر اساس گزارش Salesforce، تنها 13 درصد از مصرفکنندگان به طور کامل به شرکتها برای استفاده اخلاقی از هوش مصنوعی اعتماد دارند.

این گزارش همچنین نشان میدهد که 80 درصد از مصرفکنندگان معتقدند که برای انسان مهم است که خروجی تولید شده توسط یک ابزار هوش مصنوعی را تأیید کند. در میان این نگرانیهای مرتبط با اعتماد، شرکتها امنیت دادهها، شفافیت و استفاده اخلاقی از هوش مصنوعی را در اولویت قرار داده اند.

پائولا گلدمن، مدیر ارشد اخلاقی در Salesforce، تاکید کرد:

شرکتها ممکن است؛ مانند همیشه به دادهها نیاز داشته باشند، اما بهترین کاری که میتوانند برای محافظت از مشتریان انجام دهند، ایجاد روشهایی است که حفظ آن دادهها و اعتماد مشتریانشان را در اولویت قرار میدهد.